注意

点击 here 下载完整示例代码

学习基础知识 || 快速入门 || 张量 || 数据集和数据加载器 || 变换 || 构建模型 || 自动求导 || 优化 || 保存和加载模型

使用torch.autograd进行自动微分¶

在训练神经网络时,最常用的算法是反向传播。在这个算法中,参数(模型权重)根据损失函数相对于给定参数的梯度进行调整。

为了计算这些梯度,PyTorch 有一个内置的微分引擎,称为 torch.autograd。它支持自动计算任何计算图的梯度。

考虑最简单的单层神经网络,输入为x,参数为w和b,以及一些损失函数。它可以在PyTorch中以以下方式定义:

张量、函数和计算图¶

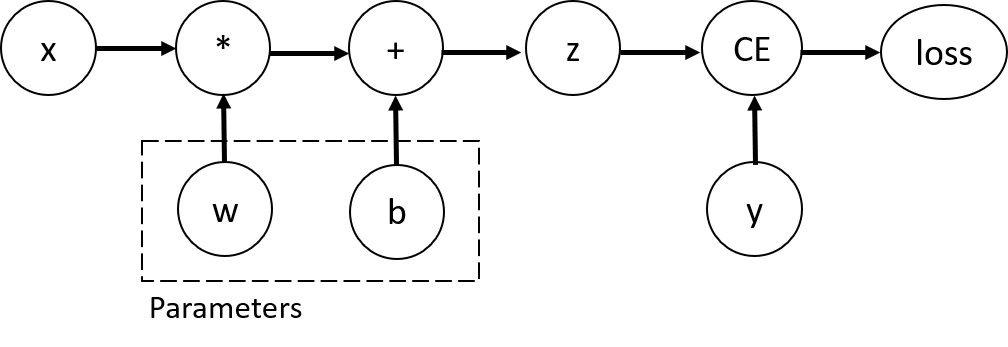

这段代码定义了以下的计算图:

在这个网络中,w 和 b 是参数,我们需要优化它们。因此,我们需要能够计算损失函数相对于这些变量的梯度。为了做到这一点,我们设置了这些张量的 requires_grad 属性。

注意

你可以在创建张量时设置requires_grad的值,或者稍后使用x.requires_grad_(True)方法来设置。

我们应用于张量以构建计算图的函数实际上是Function类的一个对象。这个对象知道如何在前向方向上计算函数,也知道如何在反向传播步骤中计算其导数。反向传播函数的引用存储在张量的grad_fn属性中。你可以在文档中找到更多关于Function的信息。

计算梯度¶

为了优化神经网络中参数的权重,我们需要计算损失函数相对于参数的导数,即我们需要在x和y的某些固定值下计算\(\frac{\partial loss}{\partial w}\)和\(\frac{\partial loss}{\partial b}\)。为了计算这些导数,我们调用loss.backward(),然后从w.grad和b.grad中检索值:

注意

- We can only obtain the

gradproperties for the leaf nodes of the computational graph, which haverequires_gradproperty set toTrue. For all other nodes in our graph, gradients will not be available. - We can only perform gradient calculations using

backwardonce on a given graph, for performance reasons. If we need to do severalbackwardcalls on the same graph, we need to passretain_graph=Trueto thebackwardcall.

禁用梯度跟踪¶

默认情况下,所有带有requires_grad=True的张量都会跟踪其计算历史并支持梯度计算。然而,在某些情况下我们不需要这样做,例如,当我们已经训练好模型并只想将其应用于一些输入数据时,即我们只想通过网络进行前向计算。我们可以通过将计算代码包裹在torch.no_grad()块中来停止跟踪计算:

实现相同结果的另一种方法是使用张量上的detach()方法:

- There are reasons you might want to disable gradient tracking:

- To mark some parameters in your neural network at frozen parameters. This is a very common scenario for finetuning a pretrained network

- To speed up computations when you are only doing forward pass, because computations on tensors that do not track gradients would be more efficient.

更多关于计算图的内容¶

从概念上讲,autograd 在一个由 Function 对象组成的有向无环图(DAG)中记录数据(张量)和所有执行的操作(以及生成的新张量)。在这个 DAG 中,叶子节点是输入张量,根节点是输出张量。通过从根节点到叶子节点追踪这个图,你可以使用链式法则自动计算梯度。

在前向传播过程中,autograd 同时做两件事:

- run the requested operation to compute a resulting tensor

- maintain the operation’s gradient function in the DAG.

当在DAG根上调用.backward()时,反向传播开始。autograd然后:

- computes the gradients from each

.grad_fn, - accumulates them in the respective tensor’s

.gradattribute - using the chain rule, propagates all the way to the leaf tensors.

注意

在PyTorch中,DAGs是动态的

需要注意的是,图是从头开始重新创建的;每次

.backward() 调用后,autograd 开始填充一个新图。这正是允许你在模型中使用控制流语句的原因;

如果需要,你可以在每次迭代时改变形状、大小和操作。

可选阅读:张量梯度和雅可比乘积¶

在许多情况下,我们有一个标量损失函数,并且需要计算相对于某些参数的梯度。然而,有些情况下输出函数是一个任意的张量。在这种情况下,PyTorch允许你计算所谓的雅可比积,而不是实际的梯度。

对于一个向量函数 \(\vec{y}=f(\vec{x})\),其中 \(\vec{x}=\langle x_1,\dots,x_n\rangle\) 和 \(\vec{y}=\langle y_1,\dots,y_m\rangle\),关于 \(\vec{x}\) 的梯度由 雅可比矩阵 给出:

PyTorch 允许你计算给定输入向量 \(v=(v_1 \dots v_m)\) 的 雅可比积 \(v^T\cdot J\),而不是计算雅可比矩阵本身。这是通过调用 backward 并将 \(v\) 作为参数来实现的。\(v\) 的大小应与我们想要计算乘积的原始张量的大小相同:

请注意,当我们第二次使用相同的参数调用backward时,梯度的值是不同的。这是因为在进行backward传播时,PyTorch会累积梯度,即计算出的梯度值会加到计算图的所有叶节点的grad属性上。如果你想计算正确的梯度,你需要先将grad属性清零。在实际训练中,优化器会帮助我们完成这个操作。

注意

之前我们调用backward()函数时没有使用参数。这基本上等同于调用backward(torch.tensor(1.0)),这是在标量值函数(例如神经网络训练中的损失)情况下计算梯度的一种有用方法。